Partial correlation이란?

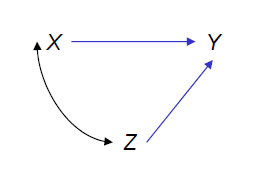

- 어떤 두 변수 사이의 연관에서 영향을 줄 수 있는 하나 또는 그 이상의 변수를 통제해 관계의 strength와 direction을 결과로 나타내는 분석 방법이다. 통제 변수를 공변량 또는 3차 변수라고 일컫기도 한다.

Partial correlation은 어떻게 측정하는가?

- Simple linear regression (단순 선형 회귀) 을 이용해 측정하는 방법이 있다.

두 연관된 선형 회귀로부터 (Risidualize X for Z 그리고 Residualize Y for Z) 잔차를 얻고, 그 잔차 사이의 상관관계를 알아내는 방법이다.

Multiple regression (다중 회귀) : 종속 변수와 최소 두 개 이상의 독립 변수의 관계를 분석하는 방법으로, simple linear regression에서 확장되었다.

Ordinary regression의 기본 파라미터와 기준은 무엇인가?

-

Intercept (절편) : X값이 0일 때 Y의 값

-

Slope (기울기) : X값이 순차적으로 증가할 때의 Y의 증가값 (X값이 달라질 때마다 Y값도 함께 변한다)

-

Residual (잔차) : 예측된 Y값과 관찰값 사이의 편차

Least Square Criterion (최소 자승법) : 선형 함수로서, 모델에서 추정된 값과 데이터 실제 값 사이의 잔차 제곱의 합이나 평균을 최소화하게 만드는 방법이다. 이 과정에서 파라미터가 정해진다. 잔차에 제곱을 하는 이유는 negative 값과 positive 값이 함께 포함될 경우 cancel out 되기 때문이다.

Variance decomposition (분산 분해) 구성은 두 분류로 나눌 수 있다.

-

Variance that can be explained by X

-

Variance that can not be explained by X (= independent of X), 설명되지 않는 변수

표준 점수에서의 Intercept 기대값은 어떻게 구하는가?

; 절편 b0의 값은 종속 변수와 독립변수 그리고 b1과 b2의 기울기에 따라 정해진다.

R2 (R-squared) :

-

어떤 변수 X가 특정 변수 Y의 변동성을 얼마나 잘 설명하는지 범위 [0~1] 사이로 나타내는 값이다. 위에서 말한 variance decomposition에서 total variance 중 설명되는 variance가 R 스퀘어라고 할 수 있다. 예를 들어 모델이 실제 데이터와 부합하는지, 선형 모델의 경우 직선이 데이터에 핏이 잘 되는지 그 퀄리티를 나타내는 기준이기도 하다.

-

Multiple regression의 R 스퀘어 값은 적어도 한 독립 변수의 제곱된 상관계수 값만큼 크다.

-

R 스퀘어는 독립 변수(predictor)의 수가 증가할 수록 그 값도 커진다.

'공부 > 통계' 카테고리의 다른 글

| [통계] Classification & Resampling (2) | 2020.02.13 |

|---|---|

| [통계] Path Modeling 경로 모형 (4) | 2020.02.10 |

| [통계] Logistic regression 로지스틱 회귀분석 (4) | 2020.02.08 |

| [통계] Categorical regression 범주형 회귀분석 (4) | 2020.02.07 |

| [통계] 다변량 통계를 위한 기본적인 terminology (2) | 2020.02.07 |